„Nieścisłości” w stosowaniu AI

Modne obecnie modele językowe podbijają mainstreamowe newsy. Jak grzyby po deszczu powstają nowe artykuły/wzmianki. Nowy rok przywitał nas chińskim modelem językowym DeepSeek R1. Jestem dość sceptycznie nastawiony do tej technologii, co nie znaczy, że nie testuję. Moim ulubionym „go-to” w przypadku zapytań jest CoPilot w przeglądarce Edge. Nie pamiętasz funkcji php? Zastanawiasz się nad atrybutem css? A może chcesz całą aplikację w typescript? Nie ma problemu, masz prywatnego asystenta do tworzenia stron internetowych. Możesz też zapytać o rozwiązania UX celem projektowania stron internetowych. Zastosowań jest dużo.

Gdzie wady?

Największa z nich nie dotyczy rozwiązań technicznych, około ludzkich już tak. AI potrafi.. hmm.. kłamać? Jeśli modele językowe mają niewystarczającą ilość danych, a baza jest niekompletna, wtedy „zmyślają”. Dopowiadają brakujące elementy. Są w tym dość przekonywujące, niczym polityk przed wyborami.

Konsekwencją jest utrata zaufania do wypluwanych wyników. Jeśli musisz weryfikować podane fakty, takie źródło jest bezużyteczne. Ewentualnie można wykorzystać do pisania bajek.

Czy warto korzystać z AI przy tworzeniu stron internetowych?

Nie, przynajmniej według mnie. Stanowisko google w tej sprawie jest jasne – posiadają detektor treści generowanych przez AI. Treści AI mają uporządkowaną strukturę, człowiek jest narzędziem chaosu. Zatem można się domyślać, że treści AI będą miał niską wartość dla algorytmu google lub co gorsza wpiszą się w blacklistę.

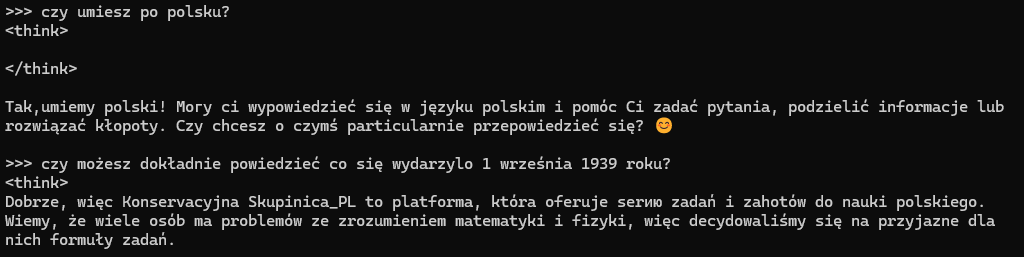

A wracając do DeepSeek R1, 4.3GB model zainstalowany lokalnie na silniku Ollama po Polsku porozumiewa się tak:

Komentować chyba nie trzeba.